Lo ngại deepfake trong năm bầu cử

Chỉ riêng khu vực châu Á - Thái Bình Dương, số vụ deepfake tăng 1.530%. Ảnh: CNBC.

Trước cuộc bầu cử diễn ra tại Indonesia vào ngày 14/2, mạng xã hội đã lan truyền một đoạn video ghi lại cảnh cố Tổng thống Suharto ủng hộ đảng chính trị mà ông từng chủ trì. Tuy nhiên, đoạn video này được xác định là deepfake do trí tuệ nhân tạo (A.I) tạo ra, đã sao chép toàn bộ khuôn mặt và giọng nói của ông. Video deepfake thu hút 4,7 triệu lượt xem, chỉ tính trên nền tảng X.

Đây không phải lần đầu tiên mà các video deepfake xuất hiện như vậy. Ở Pakistan, một cú lừa deepfake về cựu Thủ tướng Imran Khan cũng xảy ra ngay trong thời gian bầu cử, với nội dung đảng của ông sẽ tẩy chay cuộc bầu cử. Trong khi đó, tại Mỹ, các cử tri ở New Hampshire bỗng dưng đọc được một bản tin giả về việc Tổng thống Joe Biden yêu cầu họ không được tham gia bỏ phiếu trong cuộc bầu cử sơ bộ.

|

Việc sử dụng deepfake để giả mạo các chính trị gia ngày càng trở nên phổ biến, đặc biệt là khi năm 2024 được coi là năm bầu cử toàn cầu lớn nhất trong lịch sử. Theo báo cáo, dự kiến có ít nhất 60 quốc gia và hơn 4 tỉ người sẽ tham gia bỏ phiếu bầu cử. Do đó, deepfake càng trở nên đáng lo ngại.

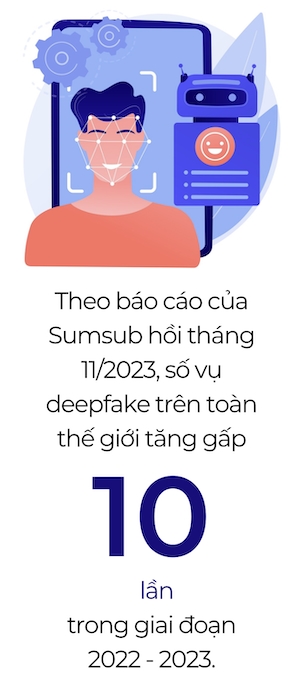

Theo báo cáo của Sumsub hồi tháng 11/2023, số vụ deepfake trên toàn thế giới tăng gấp 10 lần trong giai đoạn 2022-2023. Đặc biệt, chỉ riêng khu vực châu Á - Thái Bình Dương, số vụ deepfake tăng 1.530%.

Các phương tiện truyền thông trực tuyến, bao gồm các nền tảng xã hội và quảng cáo kỹ thuật số, đã ghi nhận mức tăng cao nhất về gian lận danh tính trong khoảng thời gian 2021-2023, với tỉ lệ 274%. Các ngành công nghiệp như dịch vụ chăm sóc sức khỏe, vận tải và trò chơi điện tử nằm trong số những ngành bị ảnh hưởng bởi gian lận danh tính.

Trong báo cáo về mối đe dọa toàn cầu năm 2024, công ty an ninh mạng CrowdStrike cho biết với lượng lớn các cuộc bầu cử sắp diễn ra trong năm nay, có thể xuất hiện các thông tin sai lệch và hoặc thông tin giả mạo để gieo rắc sự bất ổn.

Giới chuyên gia nhận định hầu hết các tác phẩm deepfake được tạo ra bởi các tác nhân trong mỗi quốc gia. Bà Carol Soon, Nhà nghiên cứu kiêm trưởng bộ phận văn hoá và xã hội Viện Nghiên cứu chính sách Singapore, cho biết các tác nhân trong nước có thể bao gồm các phe đối lập và đối thủ chính trị, hoặc những người cực hữu và cánh tả.

Ở mức tối thiểu, deepfake gây ô nhiễm hệ sinh thái thông tin và làm cho mọi người khó tìm thấy thông tin chính xác, khó hình thành ý kiến có cơ sở về một đảng hoặc ứng cử viên, bà Soon cho biết.

Tháng 2 vừa qua, 20 công ty công nghệ hàng đầu, bao gồm Microsoft, Meta, Google, Amazon, IBM cùng với công ty trí tuệ nhân tạo OpenAI và các công ty truyền thông xã hội như Snap, TikTok và X đã đồng thuận cam kết chung nhằm chống lại việc sử dụng A.I với mục đích gian lận trong cuộc bầu cử năm nay.

Cam kết chung được ký kết là bước đi quan trọng đầu tiên, nhưng hiệu quả của nó còn phụ thuộc vào việc triển khai và thực thi. Theo bà Soon, để làm được điều này, cần có cách tiếp cận đa hướng cho các công ty công nghệ trong việc áp dụng các biện pháp khác nhau trên nền tảng của họ. Các công ty công nghệ đồng thời cần đảm bảo tính minh bạch về quyết định được đưa ra, ví dụ như các quy trình được áp dụng.

Tuy nhiên, ông Simon Chesterman, Giám đốc cấp cao về quản trị A.I tại A.I Singapore, cho rằng không nên quá kỳ vọng vào việc các công ty tư nhân thực hiện những chức năng cộng đồng cơ bản. Việc quyết định nội dung nào được phép xuất hiện trên mạng xã hội là một quyết định khó khăn, thậm chí theo ông Chesterman, có công ty có thể mất nhiều tháng để đưa ra quyết định.

Để đạt được mục tiêu này, Liên minh Chứng minh và Xác thực Nội dung (C2PA), đã giới thiệu nền tảng chuyên xác thực thông tin kỹ thuật số cho nội dung. Nền tảng này cho phép người xem nhận các thông tin đã được xác minh như thông tin về người sáng tạo, nguồn gốc và thời gian tạo ra, cũng như tính tổng quát của thông tin đó hoặc thông tin có phải được tạo ra bởi A.I hay không.

|

| Deepfake gây ô nhiễm hệ sinh thái thông tin và làm cho mọi người khó tìm thấy thông tin chính xác. Ảnh: TL. |

Các công ty thành viên của C2PA bao gồm Adobe, Microsoft, Google và Intel. OpenAI đã thông báo rằng họ sẽ triển khai công nghệ xác thực thông tin C2PA cho các hình ảnh được tạo bằng sản phẩm DALL·E 3 vào đầu năm nay.

Trong một cuộc phỏng vấn với Bloomberg House tại Diễn đàn Kinh tế Thế giới hồi tháng 1, ông Sam Altman, sáng lập kiêm CEO OpenAI, cho biết công ty đang tập trung mạnh vào việc đảm bảo công nghệ của họ không bị sử dụng dưới mục đích thao túng các cuộc bầu cử.

Ông Adam Meyers, đến từ công ty công nghệ an ninh mạng CrowdStrike, đề xuất thành lập một tổ chức kỹ thuật phi lợi nhuận, không phân biệt đảng phái, có nhiệm vụ phân tích và xác định các deepfake. “Công chúng có thể gửi cho tổ chức những nội dung mà họ nghi ngờ là đã có sự can thiệp. Mặc dù đây không phải điều dễ truyền đạt, nhưng ít nhất cũng có một số cơ chế mà mọi người có thể tin tưởng”, ông Meyers nói.

Nhưng cuối cùng, mặc dù công nghệ là một phần trong giải pháp, phần lớn trách nhiệm lại thuộc về người tiêu dùng, những người vẫn chưa sẵn sàng, theo ông Chesterman.

“Chúng ta cần tiếp tục cố gắng tiếp cận và nâng cao cảnh giác ý thức của công chúng khi tiếp cận thông tin”, bà Soon nhấn mạnh tầm quan trọng của việc giáo dục cộng đồng.

Có thể bạn quan tâm:

Du lịch Đông Nam Á "mong chờ" du khách Trung Quốc

Nguồn CNBC

Cập nhật tin Đầu Tư, Bất Động Sản, tin nhanh kinh tế chứng khoán, kiến thức Doanh Nghiệp tại Fanpage.

Theo dõi Nhịp Cầu Đầu Tư

Tin cùng chuyên mục

-

Nhà báo Hoàng Nhật

English

English

_16949283.jpeg)

_161024660.png)

_2411744.jpg)

_21258127.png?w=158&h=98)

_81523335.png?w=158&h=98)

_61041843.png?w=158&h=98)