Cuộc đua chip phát triển AI của các startups và công ty đầu ngành

Nvidia thống trị thị trường chip AI nhưng những công ty mới đang tìm cách tạo dấu ấn. Ảnh: Nikkei Asia.

Trong khi các đơn vị xử lý đồ họa của Nvidia vẫn tiếp tục thống trị thị trường AI, các công ty khởi nghiệp trong khu vực châu Á tin rằng mức tiêu thụ năng lượng cao và thiết kế cồng kềnh của GPU sẽ để lại khoảng trống trên thị trường mà những công ty mới có thể lấp đầy, theo Nikkei Asia.

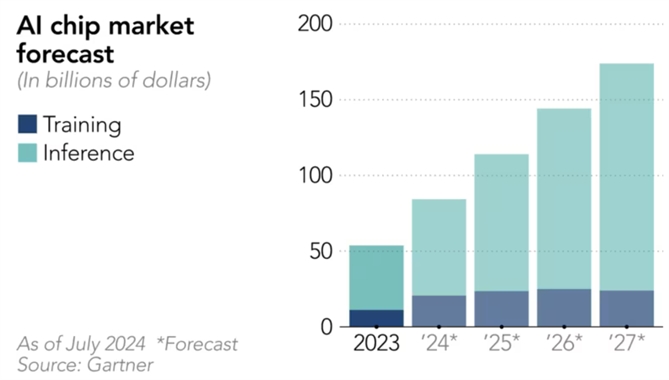

Về cơ bản, có hai loại chip AI. Một là chip "suy luận", được sử dụng để vận hành các mô hình AI hiện có. Loại còn lại là chip "đào tạo", xử lý dữ liệu công suất cao được sử dụng để phát triển các mô hình AI mới. Ví dụ, OpenAI cần hàng chục nghìn chip đào tạo để phát triển các mô hình mới cho chatbot ChatGPT. Nhưng để ChatGPT trả lời một câu hỏi, nó sẽ sử dụng chip suy luận.

|

| Dự đoán thị trường chip AI trong tương lai (theo loại chip, tính theo tỉ USD). Ảnh: Nikkei Asia. |

"Chưa có ai đưa ra được thiết kế chip suy luận hoàn hảo", ông Toru Nishikawa, CEO của công ty AI kỳ lân Preferred Networks (PFN) của Nhật Bản, cho biết. "Tôi nghĩ sẽ có những thay đổi lớn về trong lĩnh vực này ... và bất kỳ ai cung cấp thiết kế phù hợp với mức giá thấp nhất sẽ chiến thắng".

Trong khi PFN đang phát triển chip đào tạo, công ty cũng coi thị trường chip suy luận mới nổi là cơ hội để kiểm tra các sản phẩm của mình.

Thành công của Nvidia chủ yếu đến từ sự bùng nổ trong đào tạo, nhờ vào khả năng xử lý số lượng lớn phép tính song song mà quá trình phát triển các mô hình AI yêu cầu của GPU. Nhưng GPU quá đắt và cồng kềnh để trở thành lựa chọn khả thi cho máy tính xách tay và thiết bị đeo. Ví dụ, chip AI của Nvidia dành cho trung tâm dữ liệu có giá từ 25.000-40.000 USD/chiếc, đắt hơn 7-8 lần so với các sản phẩm thông thường.

"Nếu chip suy luận có cùng chi phí với chip đào tạo, mô hình kinh doanh đó sẽ không bao giờ bền vững. Chúng ta cần phát triển chip AI hoạt động trên PC", ông Nishikawa cho biết.

Các nhà phân tích đồng ý. "Có kỳ vọng rằng nhu cầu về AI trên thiết bị sẽ tăng lên trong tương lai gần, điều này khuyến khích các công ty đầu tư mạo hiểm tham gia vào cuộc chơi", ông Kazuhiro Sugiyama, Giám đốc Tư vấn của công ty nghiên cứu Omdia của Anh, cho biết.

Các thị trường tiềm năng cho AI trên thiết bị bao gồm PC, điện thoại thông minh, camera giám sát và máy bay không người lái.

Ông Sugiyama nói thêm: "GPU của Nvidia chủ yếu phù hợp cho mục đích đào tạo, nhưng chúng tôi đang thấy nhiều hãng mới phát triển chip có thể hướng đến cả mục đích đào tạo và suy luận".

Những công ty mới này bao gồm SambaNova Systems có trụ sở tại Mỹ, được Quỹ Vision Fund của SoftBank hỗ trợ; Tenstorrent, được thành lập bởi một cựu kỹ sư của Intel; và công ty Graphcore của Anh, gần đây đã được SoftBank mua lại.

Các công ty công nghệ lớn như Google, Meta và Amazon Web Services cũng đang tham gia, chưa kể đến đối thủ AMD của Nvidia.

"Vào năm 2025 đến năm 2026, chúng ta sẽ thấy nhiều công ty tham gia vào thị trường hiện do Nvidia nắm giữ khi các công ty công nghệ lớn bắt đầu cung cấp chip AI chuyên dụng để sử dụng trong các dịch vụ của riêng họ", ông Sugiyama cho biết, đồng thời nói thêm rằng "Vấn đề số 1" với các sản phẩm của Nvidia là giá của chúng. Một chip Nvidia có thể có giá 25.000 USD, đây là gánh nặng đối với một công ty muốn đầu tư vào AI, ông cho biết.

_191710703.png) |

Ngay cả các nhà cung cấp của Nvidia cũng đã đề cập đến vấn đề về giá.

Ông Chey Tae-won, Chủ tịch Tập đoàn SK của Hàn Quốc, cho biết vào tháng 7: "Các công ty rất mong muốn sử dụng chip riêng của họ thay vì chip Nvidia đắt đỏ".

Đơn vị SK Hynix của tập đoàn cung cấp bộ nhớ băng thông cao (HBM) cho chipset AI của Nvidia, nhưng ông Chey cho biết nếu những công ty mới như Microsoft và Google có thể sản xuất chip AI rẻ hơn, "tôi nghĩ mô hình kinh doanh do Nvidia dẫn đầu có thể bị phá vỡ".

Và chi phí không phải là vấn đề duy nhất.

Theo báo cáo, chip Blackwell thế hệ tiếp theo của Nvidia tiêu thụ tới 1.200 watt điện. "Vài năm trước, một con chip tiêu thụ hơn 100 watt được coi là khá quá đáng", công ty khởi nghiệp chip Esperanto Technologies của Mỹ cho biết.

Một số chuyên gia ước tính rằng, việc đào tạo một mô hình như ChatGPT-3 tiêu thụ nhiều điện hơn mức sử dụng của 1.000 hộ gia đình trong một năm.

Có thể bạn quan tâm:

Ngành công nghiệp pin Trung Quốc đối mặt với làn sóng sáp nhập

Nguồn Nikkei Asia

Cập nhật tin Đầu Tư, Bất Động Sản, tin nhanh kinh tế chứng khoán, kiến thức Doanh Nghiệp tại Fanpage.

Theo dõi Nhịp Cầu Đầu Tư

Tin cùng chuyên mục

-

Đức Minh

-

Trực Thanh

-

Nguyễn Trang - Song Thu

Đưa tiếng Anh trở thành ngôn ngữ thứ hai trong giáo dục đại học

-

Phi Vũ

-

Lam Hồng

-

Khánh Vũ

Tin nổi bật trong ngày

Tin mới

-

Kim Dung

-

Đức Minh

English

English

_6845658.png)

_61154205.png)

_61126529.png)