ChatGPT phát động "cuộc đua" trí tuệ nhân tạo và phản ứng của các nhà lãnh đạo

Ở Mỹ, Nhà Trắng và Thượng viện đã triệu tập các nhà lãnh đạo công nghệ để thảo luận về những rủi ro mà trí tuệ nhân tạo đem lại.

Nếu thế giới A.I "bước vào" đời thật

Hãy tưởng tượng một thế giới nơi A.I vượt qua sự am hiểu của con người trong gần như mọi lĩnh vực và có thể viết mã trong một ngày những gì các công ty công nghệ lớn nhất trên thế giới tạo ra trong nhiều năm. Bây giờ, hãy tưởng tượng rằng thế giới đó sẽ trở thành hiện thực của chúng ta trong vòng 10 năm tới.

Trong một loạt bài phát biểu tại 20 quốc gia trong thời gian qua, Sam Altman, CEO của startup OpenAI, đã trình bày một cách rất thuyết phục một khung pháp lý toàn cầu cho A.I rằng công ty của ông đã giúp khởi đầu cơn sốt A.I vào tháng 11 với việc ra mắt chatbot ChatGPT, đã chứng minh tiềm năng to lớn của A.I.

Trong khi hầu hết các tỉ phú công nghệ phản đối nỗ lực quy định từ chính phủ, Altman đã cố gắng nói cho các chính phủ biết rằng họ cần bắt đầu suy nghĩ về quy định ngay bây giờ, trước khi quá muộn. "Nguồn thu đem đến từ ChatGpt là khổng lồ. Cuộc cách mạng A.I sẽ tạo ra sự giàu có chia sẻ và làm cho việc cải thiện chất lượng cuộc sống của mọi người trở nên dễ thở hơn", ông nói tại một hội nghị A.I tại Bắc Kinh vào ngày 10/6.

"Tuy nhiên, chúng ta phải cùng nhau quản lý rủi ro để đạt được mục tiêu đó", ông thêm vào bài phát biểu công khai đầu tiên của ông tại Trung Quốc, nơi ChatGPT bị cấm. Sau đó, ông cũng đưa ra một vài dẫn chứng, cụ thể: "Nếu không cẩn thận, một hệ thống A.I không đồng trục nhằm cải thiện kết quả sức khỏe cộng đồng có thể làm xáo trộn toàn bộ hệ thống chăm sóc sức khỏe bằng cách cung cấp lời khuyên không có căn cứ.

|

| Giám đốc DDiều hành OpenAI Sam Altman tham dự một buổi chia sẻ với các sinh viên tại Đại học Keio ở Tokyo. Ảnh: Nikkei Aisa. |

Khi A.I trở nên mạnh mẽ và phổ biến hơn, các nhà lãnh đạo ngành công nghệ như Altman, các nhà nghiên cứu và nhà quản lý đang thảo luận về các biện pháp giám sát công nghệ mạnh mẽ này, khi các vấn đề như tin giả, thiên vị và mất việc làm ngày càng được đặt lên hàng đầu cùng với tiềm năng của A.I.

Chủ yếu nhờ vào sự thành công của ChatGPT, các chính phủ trên khắp thế giới trong năm nay đã thực hiện những nỗ lực đầu tiên để thích ứng với A.I. Trong tháng 4, Trung Quốc đã công bố dự thảo luật A.I tạo ra sinh động, dự kiến trở thành luật công nghệ đầu tiên trên thế giới có hiệu lực. Đạo luật A.I của Liên minh châu Âu, một dự luật toàn diện về A.I đã thông qua phiếu bỏ phiếu của quốc hội vào tháng 5, tiến gần hơn đến việc trở thành luật pháp. Tại Hội nghị G7 tháng trước tại thành phố Hiroshima, Nhật, quy định quốc tế về A.I đã trở thành một chủ đề chính.

Ở Mỹ, Nhà Trắng và Thượng viện đã triệu tập các nhà lãnh đạo công nghệ để thảo luận về những rủi ro mà A.I đem lại. Thông qua một loạt phiên điều trần và cuộc đàm phán nội bộ tại Washington, các lập pháp viên và cơ quan quản lý đã cố gắng xác định cách tốt nhất để áp đặt giới hạn đối với công nghệ này, nếu có.

|

Những quyết định quy định này đem đến một yếu tố không thể dự đoán trong quá trình phát triển và ứng dụng của A.I. Các nhà quản lý có thể ảnh hưởng mạnh mẽ đến sự phát triển của A.I thông qua các quy tắc quản lý loại dữ liệu mà A.I sinh động có thể huấn luyện mô hình trên, ví dụ như việc sử dụng A.I trong lĩnh vực duy trì an ninh công cộng.

"Làm thế nào các công nghệ này phát triển không phải là sự tất yếu", như Lina Khan, Trưởng Ủy ban Thương mại Liên bang Mỹ, cơ quan chịu trách nhiệm thi hành các quy định về cạnh tranh, đã nói trong một cuộc phỏng vấn với CNBC.

|

| Chủ tịch Ủy ban Thương mại Liên bang Mỹ, bà Lina M. Khan, cho biết trong tháng 5 rằng các nhà hoạch định chính sách cần phải lựa chọn để đưa các công nghệ mới vào "theo hướng phát triển lành mạnh và có lợi hơn". |

Trung Quốc: Phương pháp từ trên xuống (top-down)

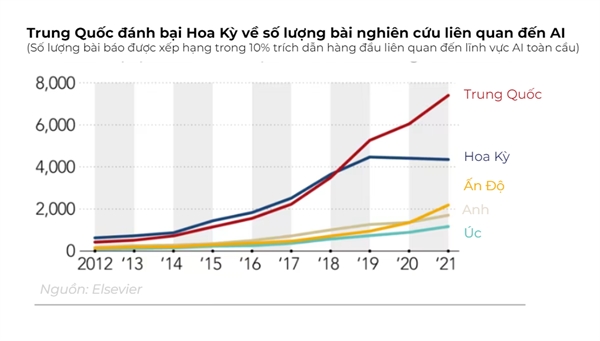

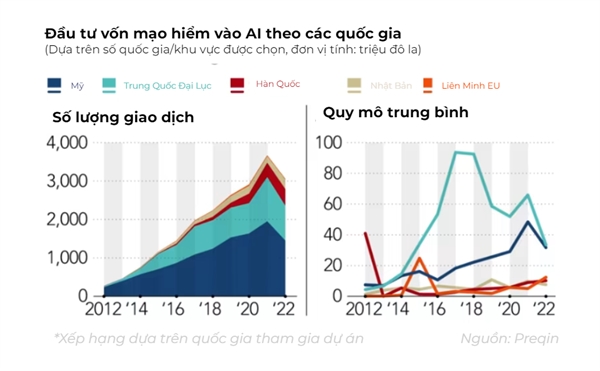

Tuy nhiên, với mức độ căng thẳng hiện tại giữa Bắc Kinh và Washington, khó có thể tưởng tượng được là những siêu cường đang dẫn đầu nghiên cứu A.I này có thể đồng ý về việc quy định hiện tượng này.

Vào tháng 4, năm tháng sau khi chatbot của Open AI được công bố cho công chúng, và khi hầu hết các chính phủ vẫn đang suy nghĩ về việc bắt đầu quy định A.I ở đâu, Trung Quốc đã công bố dự thảo luật yêu cầu tất cả các công ty phát triển sản phẩm A.I sinh động phải đăng ký với chính phủ và qua các bài kiểm tra an ninh trước khi triển khai ra công chúng.

Ngôn ngữ trong dự thảo tương tự như những quy định mới mà Bắc Kinh đã ban hành trong cuộc đàn áp rộng rãi về lĩnh vực công nghệ trong 2 năm qua. Từ chống độc quyền đến bảo vệ dữ liệu, cuộc đàn áp đã giải quyết một loạt vấn đề, nhưng tất cả các biện pháp đều nhấn mạnh yêu cầu các công ty công nghệ phản ánh những "giá trị cốt lõi xã hội chủ nghĩa" tương tự.

Hội đồng Nhà nước Trung Quốc đã đề ra khát vọng trong lĩnh vực A.I từ năm 2017, với một kế hoạch định hướng ngành công nghiệp trị giá 1.000 tỉ nhân dân tệ (hơn 140 tỉ USD) vào năm 2030; kể từ đó, đã có nhiều chính sách cấp quốc gia và địa phương cung cấp vốn và hỗ trợ khác nhau cho phát triển A.I.

|

CEO của Microsoft, Google và OpenAI đã gặp Tổng thống Mỹ Joe Biden vào tháng 5. Theo thông tin từ Nhà Trắng, chính quyền đã kêu gọi các công ty A.I hàng đầu để "mô hình hóa hành vi có trách nhiệm" và "tiến hành các biện pháp để đảm bảo sự đổi mới có trách nhiệm và các biện pháp bảo vệ thích hợp".

|

| Giám đốc Điều hành của Alphabet, Sundar Pichai, và Giám đốc Điều hành của OpenAI, Sam Altman, đến Nhà Trắng để tham dự cuộc họp với Phó Tổng thống Kamala Harris về A.I vào ngày 4/5. (Nguồn: AP) |

"Đó chỉ là biểu tượng," John B. Quinn, người sáng lập và đối tác quản lý của công ty luật Quinn Emanuel Urquhart & Sullivan có trụ sở tại Los Angeles, nói thêm rằng trong khi ông không kỳ vọng chính quyền Biden sẽ ký bất kỳ luật liên bang nào về A.I trong thời gian gần, mặc dù đã có rất nhiều hành động quy định tại cấp bang.

Ví dụ, bang California đã đưa ra một dự luật vào tháng 4 nhằm điều chỉnh cách A.I được sử dụng trong "công cụ quyết định tự động", chẳng hạn như các thuật toán lọc ứng viên công việc.

Trên mức liên bang, Thượng viện Mỹ đã tổ chức một cuộc điều trần về A.I vào tháng 5, trong đó CEO của OpenAI, Sam Altman, đã làm chứng và kêu gọi việc quy định A.I hơn nữa và hình thành một cơ quan Mỹ hoặc toàn cầu để giám sát việc tuân thủ các tiêu chuẩn an toàn của các công ty.

"Chúng ta không đơn độc trong việc phát triển công nghệ này", Altman cho biết thêm. "Quan trọng là các nhà lập chính sách xem xét cách thực thi quy định về cấp phép trên quy mô toàn cầu và đảm bảo sự hợp tác quốc tế về an toàn A.I, bao gồm việc xem xét các cơ chế giám sát quốc tế giữa các chính phủ và thiết lập tiêu chuẩn".

|

| Chính quyền Tổng thống Mỹ Joe Biden vào cuối năm 2022 đã tiết lộ một kế hoạch để quy định A.I, nhưng việc thực hiện vẫn chưa rõ ràng. Nguồn: AP. |

Trong khi đó, chính quyền Biden đã giới thiệu một sáng kiến được gọi là "Bản thiết kế cho Đạo luật Quyền tự do Trí tuệ Nhân tạo" vào tháng 10, và người lãnh đạo đa số Thượng viện Chuck Schumer đang làm việc với một khung pháp lý để quy định A.I ở mức quốc gia. Cả 2 đều thể hiện những nguyên tắc cấp cao mà không đi vào chi tiết về cách thức thực thi trong thực tế.

Trong bối cảnh thiếu quy định liên bang, Microsoft và Google, 2 công ty dẫn đầu trong lĩnh vực này, đã thành lập các nhóm chịu trách nhiệm quản lý A.I nội bộ và công bố những nguyên tắc của riêng mình về cách công ty sẽ phát triển và triển khai các công nghệ liên quan một cách có trách nhiệm. Cả 2 đề cập đến "an toàn, tính bao hàm và trách nhiệm" là những nguyên tắc chính trong việc phát triển và triển khai các sản phẩm A.I của họ.

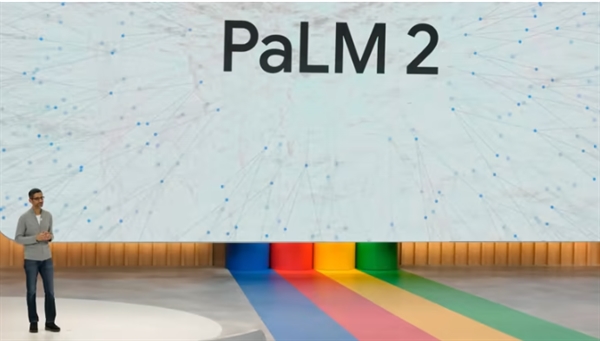

Ở Google, điều này đã dẫn đến việc thành lập nhóm Trí tuệ Nhân tạo Trách nhiệm, tham gia vào việc thiết kế các mô hình. "Chúng tôi đã bắt đầu làm việc với nhóm Trí tuệ Nhân tạo Trách nhiệm trong Google từ đầu", Andrew Dai, kỹ sư phần mềm chính tại Google DeepMind, người dẫn đầu việc phát triển các mô hình ngôn ngữ lớn của Công ty, bao gồm cả PaLM 2 mới nhất, cho biết.

Các tính năng Trí tuệ Nhân tạo Trách nhiệm bao gồm đo lường mức độ mà mô hình ghi nhớ dữ liệu huấn luyện, hoặc kiểm soát mức độ độc hại của kết quả đầu ra từ mô hình, ngoài việc lọc chất lượng và sao chép dữ liệu, Dai nói với Nikkei Asia trong một buổi thông tin.

Theo Dai, sau khi huấn luyện, mô hình ngôn ngữ lớn như PaLM 2 đã được nhóm Trí tuệ Nhân tạo Trách nhiệm xem xét kỹ lưỡng trước khi triển khai.

|

| Giám đốc Điều hành Alphabet, Sundar Pichai, phát biểu về mô hình ngôn ngữ lớn PaLM 2 mới tại một sự kiện của Google tại California, Mỹ, vào ngày 10/5. Nguồn: AP. |

Tuy nhiên, một số người đặt câu hỏi liệu những nỗ lực dẫn đầu từ ngành công nghiệp ở Mỹ có dẫn đến việc quản lý A.I hiệu quả, vì việc quy định A.I có thể làm chậm tiến trình phát triển trong bối cảnh cạnh tranh gay gắt giữa các nhà lãnh đạo.

Các chuyên gia cho biết rằng rất khó thúc đẩy các công ty tự quản lý khi các đối thủ đang tiến lên với tốc độ tối đa, cũng như không dễ dàng thuyết phục các công ty cạnh tranh đồng ý về cách tự quản lý cần được thiết kế như thế nào.

"Đó đơn giản là việc đạp ga và đạp phanh cùng một lúc trên chiếc xe", Paul Kedrosky, đối tác quản lý tại SK Ventures, nói.

"Nếu bạn là người điều khiển đạp phanh trong công ty, mọi người có thể tha thứ cho bạn trong một thời gian", Kedrosky nói, "nhưng nếu vốn hóa thị trường của công ty bắt đầu giảm, bạn sẽ bị sa thải".

Ví dụ, Altman của OpenAI, người đã kêu gọi quy định A.I của Mỹ và quốc tế tại buổi lắng nghe Thượng viện ngày 16/5, đã nói tại một hội nghị ở Luân Đôn vào ngày 24/5 rằng ChatGPT và Công ty sẽ rời khỏi thị trường Liên minh châu Âu nếu luật A.I của khu vực này trở nên quá nặng nề, theo báo chí đưa tin. Bình luận của ông đã gây phẫn nộ của Thierry Breton, Ủy viên Liên minh châu Âu về thị trường nội địa, người gọi đó là "tống tiền".

Sau đó, CEO này đã rút lại nhận xét trên Twitter và nói rằng Công ty "không có kế hoạch rời đi".

|

Bart Selman, một giáo sư tại Đại học Cornell, và hàng trăm nhà nghiên cứu A.I nổi tiếng khác đã ký một bức thư mở vào tháng 3 yêu cầu tạm dừng đào tạo A.I trong 6 tháng. Ông nói rằng ngành công nghiệp A.I ở Mỹ ít động lực để chịu các chi phí để tự quản lý một cách có ý nghĩa.

"So với châu Âu, nơi họ đã có luật dữ liệu và quyền riêng tư hợp lý", Selman nói, "Các tập đoàn công nghệ lớn đã gây chậm lại (quy định dữ liệu và quyền riêng tư) ở Mỹ".

"Các tập đoàn công nghệ lớn có thể nói, "Được rồi, chúng ta hãy cùng làm việc về quy định A.I. Chỉ cần cho chúng tôi thêm 5 năm nữa. Nhưng đến lúc đó, sẽ quá muộn", Selman nói.

"Khi bạn làm việc cho một công ty, bạn thực sự không thể chống lại lợi ích của công ty. Vì vậy, bạn phải có những người đã loại bỏ một phần lợi ích đó và không có mâu thuẫn quá lớn (trong việc hình thành chính sách về A.I)", ông nói thêm.

Kể từ tháng 3, đã có một số bức thư mở tương tự như bức thư mà Selman đã ký kết và được ủng hộ bởi nhiều chuyên gia trong ngành công nghệ và các nhà nghiên cứu cao cấp khác trong lĩnh vực này. Tất cả đều cảnh báo về các rủi ro nghiêm trọng của A.I, nhưng cho đến nay chưa dẫn đến hành động lập pháp hoặc khác.

"Một phần của bức thư (yêu cầu tạm dừng 6 tháng) là để thu hút sự chú ý vào vấn đề. Chúng tôi đã biết rằng việc thực sự áp đặt việc tạm dừng này sẽ gần như không thể", Selman nói. "Mọi thứ đã trở nên không kiểm soát".

Có thể bạn quan tâm:

Kinh tế New Zealand rơi vào suy thoái

Nguồn Nikkei Asia

Cập nhật tin Đầu Tư, Bất Động Sản, tin nhanh kinh tế chứng khoán, kiến thức Doanh Nghiệp tại Fanpage.

Theo dõi Nhịp Cầu Đầu Tư

English

English

_71457353.jpg)

_81610306.png)

_81610306.png?w=158&h=98)